TwitterやHacker Newsでオープンソースのエージェントフレームワーク「OpenClaw」が話題になり始めたとき、ある共通点が見えてきました。シェルコマンドを自動実行し、トレードを行い、メールを整理する自律型PCの投稿が急増し、その多くがMac Miniのクラスター構成だったのです。こうしてMac Miniは「常時稼働型AIアシスタント」の定番ハードとして一気に広まりました。

しかし、多くの人が勢いのまま導入する中で、ある重要な問いが置き去りにされています。「本当にMac Miniが最適解なのか?」と。とはいえ、結論はそんなに簡単なものではありません。

Mac Miniには明確な強みがある一方で、見落とされがちな制約も存在します。

本記事では、最新のx86ミニPCと比較しながら、性能・価格・プライバシー・ローカルLLM対応・24時間運用の安定性という観点で検証し、OpenClawに最適な選択を整理します。結論だけ知りたい方は、記事の最後の方にある比較表をご覧ください。

OpenClawに必要なハードウェア要件

OpenClaw自体は非常に軽量なフレームワークです。必要なスペックは「エージェント」ではなく、「使い方」によって決まります。

主なユーザータイプは以下の3つです。

|

クラウドAPI利用タイプ

外部モデルをAPI経由で利用

外部のモデルを呼び出して使うケースです。ローカル性能はそれほど重要ではなく、主に接続の安定性が重視されます。

重要ポイント

– 安定したインターネット接続

– 常時接続の信頼性 – 標準的なメモリ構成(16GB前後) – 低消費電力 |

ローカルLLM利用タイプ

ローカルでモデルを実行

プライバシー確保やコスト削減、オフライン利用のためにローカルでモデルを動かすタイプです。高い処理性能が求められます。

重要ポイント

– 大容量RAM(32GB以上推奨)

– 推論処理に対応できるGPU性能 – 高負荷時の安定した冷却性能 – 長時間処理に耐える構成 |

常時稼働エージェントタイプ

常時稼働用途

24時間365日稼働させる用途です。長時間の安定動作を前提とした運用が求められます。

重要ポイント

– 低く安定した消費電力

– 発熱の少なさ・静音性 – 長時間の安定稼働 – 継続運用に適した信頼性 |

このユーザータイプの違いはかなり重要です。クラウドAPI中心であれば、16GB RAMのミニPCでも十分運用できますが、逆に、使わない性能のために高額なマシンを選ぶ必要はありません。

Mac MiniがOpenClawで強い理由

Mac Miniが定番になったのには理由があり、特にApple環境を使っている人には強力な選択肢です。

まず、Mシリーズチップはシングルスレッド性能が非常に高く、エージェントの応答が速いのが特徴です。AnandTechなどの検証でも、単一コア性能が要求される処理では優れた結果が確認されています。

AIを用いた際の判断やタスク処理のテンポが速くなる点は明確なメリットで、さらに、静音性と熱設計はトップクラスです。高負荷時でも動作音は控えめで、サーマルスロットリングも起きにくく、長時間運用でも安定します。自宅やオフィスでの常時稼働に適しており、加えて、Appleサービスとの統合も大きな強みです。

iMessageやFaceTimeなどとネイティブ連携できる環境はMac Miniのみで、この点が決定打になるユーザーも少なくありません。

価格面でも、エントリーモデルは比較的手を出しやすく、軽い用途ならコストパフォーマンスも悪くありません。

👉Mac miniを超えるかも?今買いたいおすすめWindowsミニPC

Mac Miniの見落とされがちなポイント

一方で、AI用途では無視できないポイントもあります。

まずRAMはオンボード固定であり、購入後の増設は不可能で、アップグレードは購入時にしか選べません。しかも価格は高めで、8GB追加ごとに大きくコストが跳ね上がり、結果として、「足りないか、割高か」の二択になりがちです。

ストレージも同様で、内部ストレージは拡張できず、外付けに頼ると管理が煩雑になります。

LLMのチェックポイントや大規模データを扱う場合、この制約は無視できません、また、Linux運用の自由度にも制限が掛かってくるのです。また、Asahi Linuxの進展はあるものの、x86環境と比べるとツールやDockerイメージ、ハードウェア互換性の面でも制約が残ります。

さらに、LANポートは1つのみという点も見逃せず、デュアルLANが使えないため、ネットワーク分離や物理的なセキュリティ構成が組みにくく、ホームラボ用途では不利と言えるでしょう。

x86ミニPCがOpenClawに強い理由

GEEKOMのようなx86ミニPCは、「拡張性とコスト効率」を重視する設計です。まず価格に対するスペックが明確に優れており、Mac Miniより安価でありながら、RAMやストレージが倍以上という構成も珍しくありません。

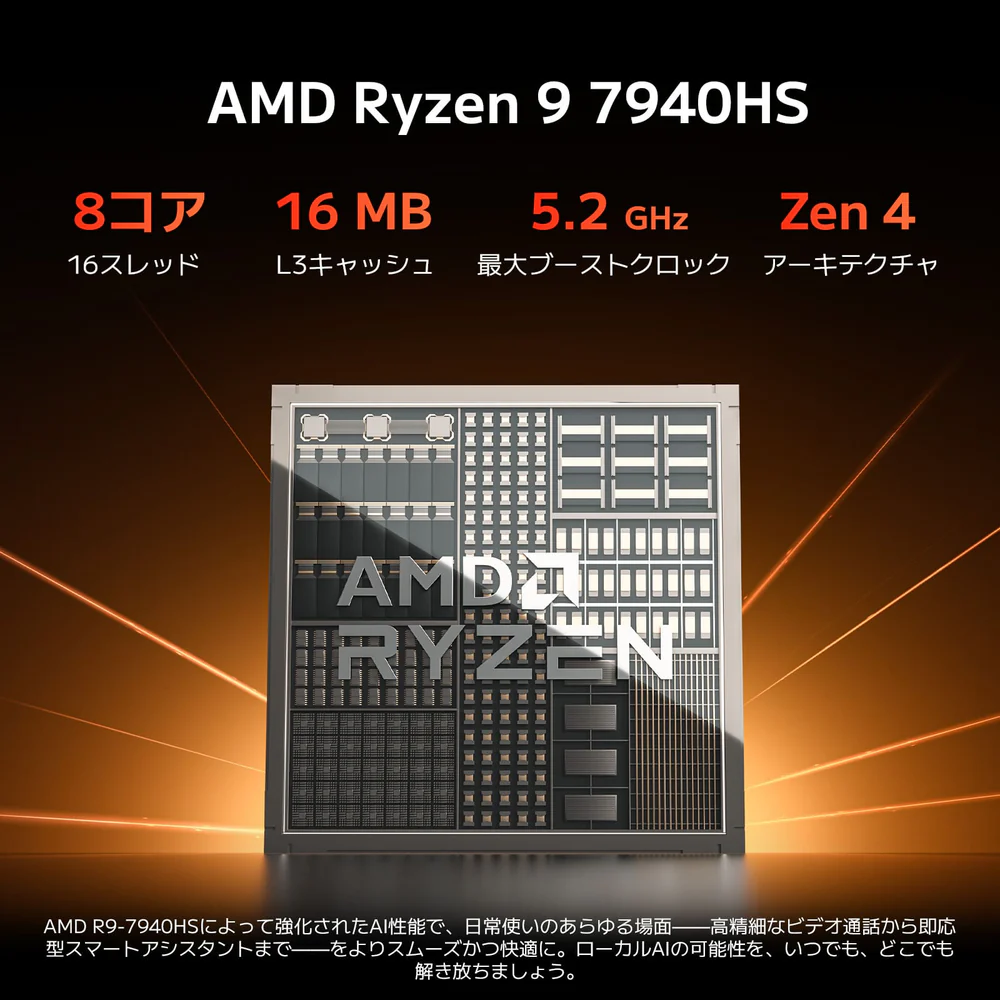

しかも後から増設可能で、クラウドAPI用途ならGEEKOM A7 Maxが有力です。Ryzen 9 7940HS、最大64GBのDDR5、デュアル2.5G LANを備え、価格を抑えつつ実用性は十分です。

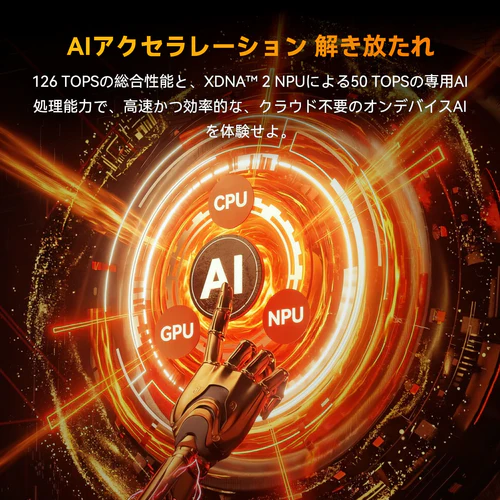

ローカルLLMを動かすならGEEKOM A9 Maxが適しているでしょう。50 TOPSクラスのNPUと最大128GBメモリにより、7B〜13Bモデルの推論も現実的にこなせます。

さらに上位のA9 Megaは、AI開発や重い推論処理に対応する構成です。126 TOPS超の性能とRadeon 890Mにより、複数モデルの同時運用や高度な開発用途にも対応できます。

OpenClaw用途別おすすめ構成

用途ごとに最適な選択は明確に分かれてきます。

| 用途 | 推奨機種 | 理由 |

|---|---|---|

| 予算を抑えたい | GEEKOM A7 MAX | 32GBの増設可能なRAMにデュアルLANを搭載しつつ、価格は12万円未満 |

| iMessageが必要 | Mac Mini M4 | OpenClawでiMessageをネイティブに使える |

| OpenClawとローカル7B~13Bモデルを併用したい | GEEKOM A9 max | 50TOPSのNPUを搭載し、最大128GBのDDR5メモリに対応しており、実機テストでも性能抜群。 |

| AI開発+高負荷な推論 | GEEKOM A9 Mega | 126TOPSの処理性能に加え、Radeon8060Sと最大4画面の8K出力に対応 |

| 消費電力を抑えたい | Mac Mini M4 | 冷却性能と静音性のバランスが優れている |

| プライバシーを重視 | GEEKOM + Linux | Appleのエコシステムが不要で、完全にローカル環境で運用ができる |

最終判断を分けるたった一つの質問

Mac MiniかGEEKOMかで迷った場合、判断基準は非常にシンプルです。「iMessageのネイティブ連携が必要か」これがYESならMac Miniで決まりです。この機能は代替できません。

NOであれば、選択肢は一気に広がります。GEEKOMのミニPCなら、より低コストで32GB〜128GBのメモリ、デュアルLAN、Linuxの自由度を手に入れられます。iMessageは使えませんが、普段のコミュニケーションがWhatsAppやSlack、Discord中心なら、大きなデメリットにはなりません。

まとめ

OpenClaw向けのハード選びは、「用途の切り分け」がすべてです。Mac Miniは完成度の高い一体型ソリューションですが、拡張性やコスト面では制約があります。

一方、x86ミニPCは柔軟性と性能のバランスに優れ、特にローカルLLMや開発用途では明確な優位性があります。

自分の用途がクラウド中心なのか、ローカル処理なのか、あるいは常時運用なのか。ここを明確にすることで、最適な選択が見えてきます。

常時稼働のOpenClawセットアップの準備は簡単。

GEEKOM A9 Maxを検討するか、GEEKOM A9 Megaでフルスペックで快適な作業を。

コメントを残す